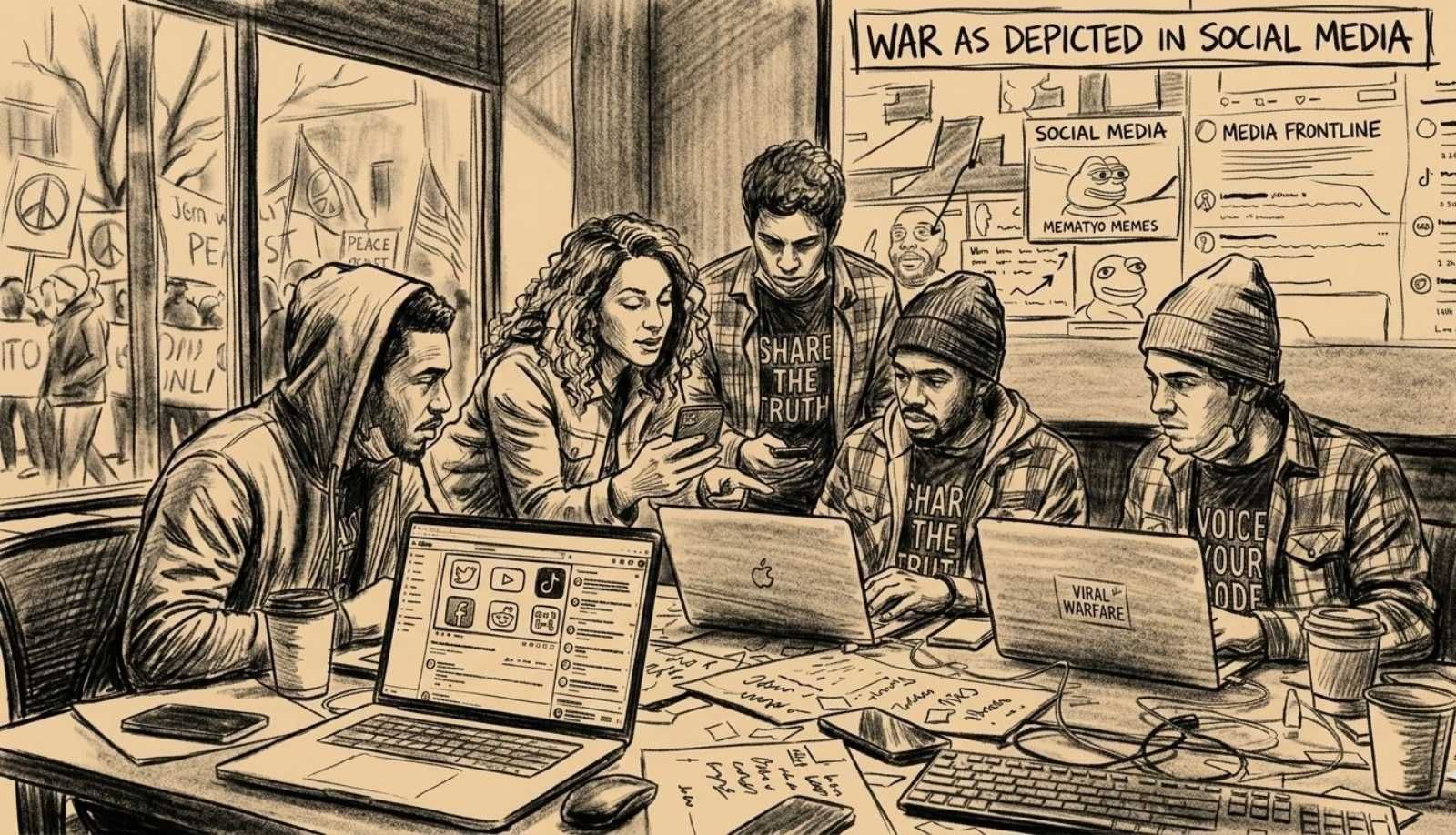

Ο πόλεμος σε «live streaming»: η διάδοση των συρράξεων στα social media

Γνωστός παρουσιαστής/δημοσιογράφος, σκοπίμως παρεξηγιάρης και αμφιλεγόμενος, δήλωσε πρόσφατα πως ενώ δεν βλέπει… τηλεόραση (sic), «είδε πόλεμο». Σαν να παρακολουθούσε σήριαλ ή talk show. Υπό αυτό το πρίσμα, ευτυχώς, ο πόλεμος δεν μεταδίδεται πλέον μόνο από τους ανταποκριτές των μεγάλων ειδησεογραφικών δικτύων. Μεταδίδεται από το κινητό ενός στρατιώτη στο χαράκωμα, από το Instagram story ενός πολίτη σε ένα καταφύγιο και από τους αλγόριθμους που αποφασίζουν τι θα δούμε στην αρχική μας σελίδα. Η διάδοση του πολέμου στα μέσα κοινωνικής δικτύωσης έχει αλλάξει ριζικά τον τρόπο που αντιλαμβανόμαστε τις συγκρούσεις, μετατρέποντάς τις από μακρινά γεγονότα σε μια ωμή, καθημερινή πραγματικότητα.

Η αμεσότητα και η «ψευδαίσθηση» της συμμετοχής

Παλαιότερα, η ενημέρωση για μια σύρραξη είχε μια χρονική υστέρηση. Σήμερα, η πληροφορία διαδίδεται σε δευτερόλεπτα. Αυτή η αμεσότητα προσφέρει:

Αδιαμεσολάβητη μαρτυρία: Βλέπουμε την ανθρώπινη πλευρά του πολέμου χωρίς το φίλτρο της κρατικής προπαγάνδας ή της συντακτικής γραμμής ενός καναλιού.

Ευαισθητοποίηση: Η παγκόσμια κοινή γνώμη μπορεί να κινητοποιηθεί ταχύτερα για ανθρωπιστική βοήθεια.

Ωστόσο, αυτή η συνεχής ροή βίντεο και εικόνων δημιουργεί μια ψευδαίσθηση συμμετοχής. Ο χρήστης αισθάνεται ότι «γνωρίζει» τι συμβαίνει στο μέτωπο, ενώ στην πραγματικότητα βλέπει μόνο αποσπασματικές, συχνά χαοτικές στιγμές.

Η σκοτεινή πλευρά: fake news και προπαγάνδα

Το μεγαλύτερο πρόβλημα στη διάδοση του πολέμου στα social media είναι η παραπληροφόρηση. Τα social media έχουν γίνει το νέο πεδίο μάχης του «υβριδικού πολέμου»:

Deepfakes και μονταρισμένα βίντεο: Σκηνές από βιντεοπαιχνίδια ή παλαιότερες συγκρούσεις παρουσιάζονται ως τωρινά γεγονότα για να επηρεάσουν το ηθικό ή να προκαλέσουν οργή.

Αλγοριθμική πόλωση: Οι αλγόριθμοι τείνουν να προωθούν το πιο σοκαριστικό περιεχόμενο, το οποίο συχνά είναι το λιγότερο διασταυρωμένο.

Echo chambers: Οι χρήστες εγκλωβίζονται σε «φούσκες» πληροφοριών που επιβεβαιώνουν μόνο τη μία πλευρά της σύγκρουσης, καθιστώντας τον διάλογο αδύνατο.

Η ψυχολογική επιβάρυνση του «doomscrolling»

Η διάδοση του πολέμου στις οθόνες μας έχει και ένα βαρύ ψυχολογικό τίμημα. Το λεγόμενο doomscrolling —η ακατάπαυστη κατανάλωση δυσάρεστων ειδήσεων— οδηγεί σε αυξημένα επίπεδα άγχους, δευτερογενές τραύμα και μια αίσθηση απόγνωσης. Η συνεχής έκθεση στη βία μάς αποευαισθητοποιεί, μετατρέποντας την ανθρώπινη τραγωδία σε ένα ακόμα scroll στην οθόνη μας.

Τα κοινωνικά δίκτυα είναι ένα πανίσχυρο εργαλείο που μπορεί να ξεσκεπάσει εγκλήματα πολέμου, αλλά και να διασπείρει το μίσος πιο γρήγορα από ποτέ. Η ευθύνη πέφτει πλέον στον χρήστη: η κριτική σκέψη, η διασταύρωση των πηγών και η συνειδητή αποχή από τη βίαιη εικόνα είναι οι μόνες άμυνες σε έναν πόλεμο που διεξάγεται πλέον, εκτός από το έδαφος, και στα pixels της οθόνης μας.

Είναι τρομακτικό το πόσο γρήγορα η Τεχνητή Νοημοσύνη (AI) μεταμόρφωσε τα social media από πεδία ενημέρωσης σε εργαστήρια προπαγάνδας. Αν ο παραδοσιακός πόλεμος βασίζεται στα πυρομαχικά, ο ψηφιακός πόλεμος βασίζεται πλέον στα data και τη δημιουργία «εναλλακτικής πραγματικότητας».

Ακολουθούν οι βασικοί τρόποι με τους οποίους η AI επηρεάζει τη διάδοση του πολέμου σήμερα:

1. Deepfakes: η διάβρωση της εμπιστοσύνης

Η AI επιτρέπει τη δημιουργία εξαιρετικά ρεαλιστικών βίντεο και ηχητικών αποσπασμάτων όπου ηγέτες ή στρατιωτικοί εμφανίζονται να λένε πράγματα που δεν είπαν ποτέ.

Στόχος: Η πρόκληση σύγχυσης, η πτώση του ηθικού ή η διασπορά ψευδών εντολών (π.χ. ένα βίντεο όπου ένας πρόεδρος καλεί σε παράδοση).

Το «Παράδοξο του Ψεύτη»: Ακόμα και όταν ένα βίντεο είναι αληθινό, η ύπαρξη των deepfakes επιτρέπει στις κυβερνήσεις να το απορρίψουν ως «προϊόν AI», κάνοντας την αλήθεια να μοιάζει με επιλογή.

2. Στρατιές από bots και «synthetics»

Δεν μιλάμε πια για απλά προφίλ χωρίς φωτογραφία. Η AI δημιουργεί:

Ρεαλιστικά avatars: Προφίλ με πρόσωπα ανθρώπων που δεν υπήρξαν ποτέ (μέσω GANs), τα οποία δείχνουν απόλυτα έμπιστα.

Αυτοματοποιημένο περιεχόμενο: Χιλιάδες σχόλια και posts που γράφονται σε δευτερόλεπτα από γλωσσικά μοντέλα (όπως το GPT), κατακλύζοντας τα hashtags ενός πολέμου για να πνίξουν τις αντίθετες φωνές.

3. Η αλγοριθμική ενίσχυση του μίσους

Οι αλγόριθμοι των social media δεν έχουν «ηθική πυξίδα»· έχουν στόχο το engagement.

Η AI των πλατφορμών αναγνωρίζει ότι το περιεχόμενο που προκαλεί οργή, φόβο ή φανατισμό κρατά τους χρήστες περισσότερη ώρα online.

Έτσι, το περιεχόμενο που παράγεται από AI για προπαγανδιστικούς σκοπούς «σερβίρεται» κατά προτεραιότητα, δημιουργώντας έναν φαύλο κύκλο πόλωσης.

4. OSINT και AI: το αντίδοτο;

Υπάρχει και η άλλη πλευρά. Η AI χρησιμοποιείται από ερευνητές (Open Source Intelligence - OSINT) για να διασταυρώνουν γεωγραφικές τοποθεσίες από βίντεο σε δευτερόλεπτα, ανιχνεύουν ψηφιακά ίχνη που αποδεικνύουν αν μια εικόνα είναι πειραγμένη, αναλύουν δορυφορικές φωτογραφίες για να εντοπίσουν ομαδικούς τάφους ή μετακινήσεις στρατευμάτων που οι κυβερνήσεις προσπαθούν να κρύψουν.

Σε περιόδους κρίσης, η ταχύτητα της AI τρέχει πιο γρήγορα από τη λογική μας. Μια απλή συμβουλή είναι ο κανόνας των 5 δευτερολέπτων: Πριν κάνεις share κάτι που σε εξοργίζει ή σε σοκάρει, περίμενε 5 δευτερόλεπτα και αναρωτήσου: «Ποιος θέλει να νιώσω έτσι και γιατί;».

Είναι αλήθεια πως η AI έχει γίνει τόσο καλή που μερικές φορές ακόμα και οι ειδικοί δυσκολεύονται. Ωστόσο, οι μηχανές κάνουν ακόμα κάποια συγκεκριμένα «λάθη» που το ανθρώπινο μάτι μπορεί να εντοπίσει αν ξέρει πού να κοιτάξει.

Ακολουθούν οι πιο αποτελεσματικοί τρόποι και εργαλεία για να ξεχωρίζεις την προπαγάνδα της AI από την πραγματικότητα:

1. Τα «κλασικά» λάθη της AI (Visual Cues)

Η AI δεν «καταλαβαίνει» τη φυσική του κόσμου, απλώς προβλέπει pixel. Ψάξε για:

Αφύσικες λεπτομέρειες στα άκρα: Κοίταξε τα χέρια (περίεργος αριθμός δακτύλων), τα αυτιά ή το πώς τα γυαλιά ηλίου ενώνονται με το πρόσωπο. Στις πολεμικές φωτογραφίες, έλεγξε αν τα όπλα ή οι στολές έχουν παράξενα σχήματα που «λιώνουν» το ένα μέσα στο άλλο.

Λάθη στο φόντο: Η AI συχνά θολώνει το φόντο με τρόπο που δεν βγάζει νόημα ή δημιουργεί ανθρώπους-φαντάσματα (μισά σώματα) πίσω από το κεντρικό θέμα.

Κείμενο και επιγραφές: Αν σε μια φωτογραφία πολέμου βλέπεις πινακίδες στους δρόμους ή γκράφιτι που μοιάζουν με «σούπα» από γράμματα ή ακαταλαβίστικα σύμβολα, είναι σχεδόν βέβαιο πως πρόκειται για AI.

Υπερβολική «τελειότητα»: Οι πραγματικές φωτογραφίες πολέμου έχουν κόκκο, θόρυβο και ατέλειες. Αν η εικόνα μοιάζει υπερβολικά κινηματογραφική, με τέλειο φωτισμό και «πλαστική» υφή στο δέρμα, να είσαι καχύποπτος.

2. Χρήση ψηφιακών εργαλείων

Αν μια εικόνα σού φαίνεται ύποπτη, χρησιμοποίησε τα εξής:

Αντίστροφη αναζήτηση εικόνας (Google Lens / TinEye): Δες αν η εικόνα υπήρχε στο διαδίκτυο πριν από τη σύρραξη ή αν προέρχεται από κάποιο άρθρο που την αναφέρει ως fake.

AI Detectors: Σελίδες όπως το Hive Moderation ή το Maybe's AI Detector μπορούν να σου δώσουν μια πιθανότητα (π.χ. 90% AI generated). Προσοχή: Δεν είναι 100% αλάνθαστα.

Metadata Checkers: Εργαλεία όπως το Jeffrey's Image Metadata Viewer μπορούν να σου δείξουν αν η εικόνα περιέχει πληροφορίες από λογισμικό επεξεργασίας ή αν έχει τραβηχτεί από πραγματική κάμερα.

3. Η μέθοδος SIFT (η πιο σημαντική)

Όταν βλέπεις μια σοκαριστική εικόνα στα social, εφάρμοσε αυτά τα 4 βήματα:

* S (Stop): Μην κάνεις share αμέσως.

* I (Investigate the source): Ποιος την ανέβασε; Είναι επίσημος δημοσιογράφος ή ένας τυχαίος λογαριασμός με 10 followers;

* F (Find better coverage): Το αναφέρουν μεγάλα ειδησεογραφικά πρακτορεία (Reuters, AP, BBC); Αν μια «τεράστια είδηση» υπάρχει μόνο σε ένα tweet, είναι μάλλον ψεύτικη.

* T (Trace claims back to the original context): Μήπως η εικόνα είναι αληθινή αλλά από άλλον πόλεμο πριν 10 χρόνια;

Η AI δυσκολεύεται πολύ με τα αντανακλαστικά. Κοίταξε τις κόρες των ματιών ή τις λακκούβες με νερό στο έδαφος. Αν οι αντανακλάσεις δεν ταιριάζουν με το περιβάλλον, η εικόνα είναι κατασκευασμένη.